Badacze z Uniwersytetu Stanford ustalili, że żaden z obecnie używanych dużych modeli językowych (LLMs), którego dotyczy sztuczna inteligencja, nie jest zgodny z przepisami UE.

To pierwsza tego rodzaju ustawa, która reguluje AI zarówno na poziomie krajowym, jak i regionalnym. Świeżo uchwalone przepisy regulują nie tylko wykorzystanie sztucznej inteligencji na terenie UE, lecz są asumptem dla innych krajów, które również z czasem dokonają usystematyzowania przepisów.

AI a przepisy

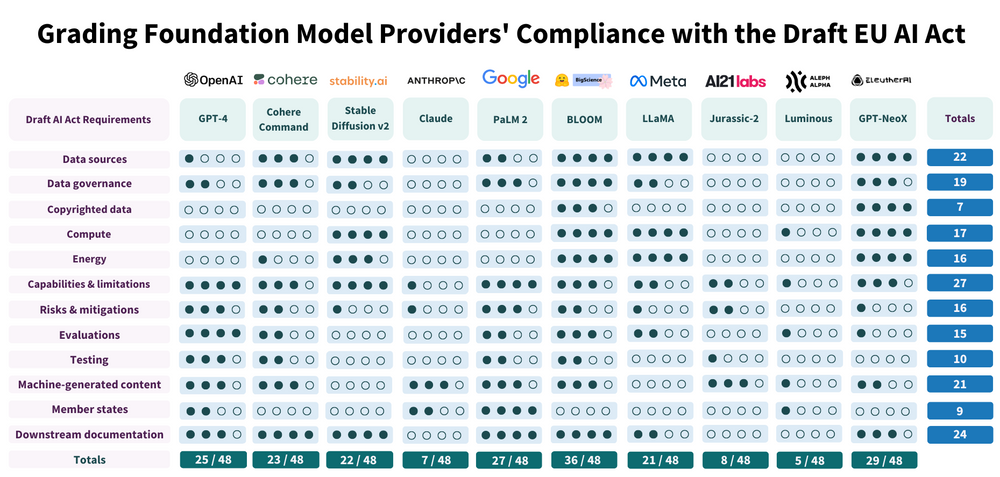

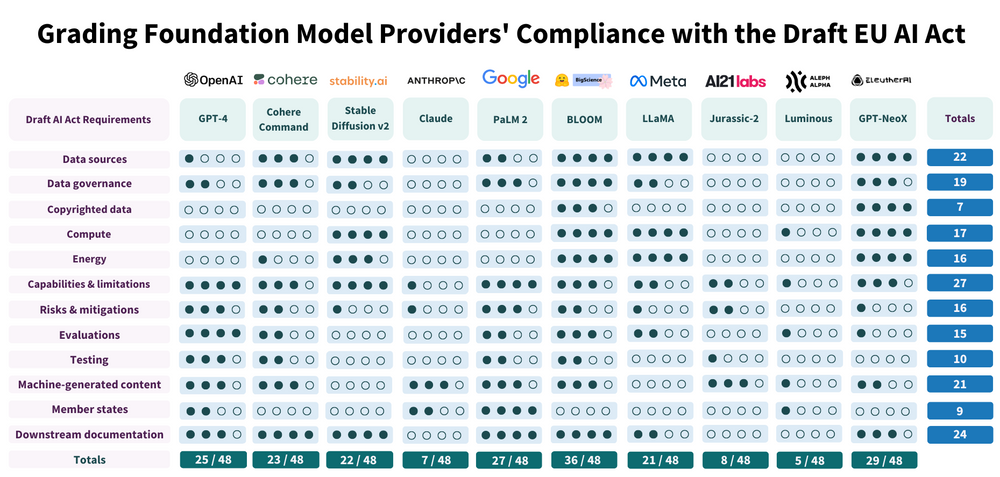

Według najnowszego badania Stanford, firmy AI mają przed sobą długą drogę, jeśli zamierzają działać zgodnie z przepisami. Do chwili obecnej oceniono dziesięć głównych dostawców modeli językowych. Przeanalizowano 12 wymagań ustawowych i zastosowano skalę od 0 do 4, która miała wskazać na jakim poziomie prawnym znajdują się poszczególne programy AI.

Badania pokazują duże różnice w poziomach zgodności z przepisami, gdzie niektóre modele otrzymały ocenę 1, a inne 3. Żaden z modeli językowych nie jest w pełni zgodny z najnowszymi regulacjami. Poniższa tabela pokazuje skalę punktów, które są przyznawane w tym zakresie:

Grafika przedstawia zgodność dostawców AI z projektem UE dotyczącym sztucznej inteligencji. Źródło: Uniwersytet Stanforda

Grafika przedstawia zgodność dostawców AI z projektem UE dotyczącym sztucznej inteligencji. Źródło: Uniwersytet Stanforda

W jakim zakresie sztuczna inteligencja nie spełnia wymogów prawnych?

Badacze znaleźli kilka punktów krytycznych co do braku legalności platform AI. Przykładowo są to

- brak przejrzystości w ujawnianiu statusu praw autorskich do danych treningowych,

- brak informacji odnośnie kwestii energetycznych programów,

- różnice między otwartymi a zamkniętymi wersjami modeli, przy czym otwarte prowadzą do lepszego ujawnienia zasobów. Niestety wiążą się z większymi wyzwaniami w monitorowaniu lub kontrolowaniu wdrożenia programu.

Dodatkowo ostatnie kilka miesięcy pokazuje zmniejszenie przejrzystości przy publikowaniu dużych modeli. Przykładowo - OpenAI nie ujawniło żadnych informacji dotyczących danych i obliczeń w swoich raportach na temat GPT-4, powołując się na to, że konkurencja może przechwycić informację o platformie.

Konieczne regulacje

Ustawa o AI zobowiązuje większych dostawców modeli podstawowych do zapewnienia przejrzystości i odpowiedzialności za przekazywane informacje. Parlament wskazuje również, że UE potrzebuje większych zasobów technicznych odnośnie analizy zgodności AI, a także specjalistów z tej branży, która po prostu jest wyjątkowo skomplikowana.

Na dzień dzisiejszy główne wyzwanie regulacyjne dotyczy tego, jak szybko dostawcy modeli mogą dostosować i zmienić swoje praktyki biznesowe, aby spełnić wymagania prawne. Szacuje się, że najpoważniejsze podmioty mogą bez problemu w krótkim czasie osiągnąć satysfakcjonujące wyniki legislacyjne. Ponadto badacze ze Stanford zaprezentowali wgląd w przyszłość regulacji AI, gdzie wskazali, że jeśli Ustawa o sztucznej inteligencji zostanie wprowadzona i egzekwowana, przyniesie to pozytywny wpływ na ekosystem nowych technologii.

Powiedzmy sobie szczerze - AI przekształca społeczeństwo, internet oraz media na niespotykaną dotąd skalę. Wolność internetu z pewnością powinna zostać zachowana, jednak skala deep fake’ków, fałszywych informacji, bądź po prostu generowanie wadliwych informacji przez najpopularniejsze programy musi zostać unormowana.

Komentarze